Websites haben gelernt, mit Browsern und dann mit Suchmaschinen zu kommunizieren. Cloudflare ist der Ansicht, dass sie nun lernen müssen, mit KI-Agenten zu sprechen, und stellt ein Tool vor, das dabei helfen soll. Eine ehrgeizige Initiative, die jedoch ebenso viele Fragen aufwirft, wie sie löst.

Wichtiges zu merken:

- Cloudflare startet isitagentready.com, ein kostenloses Tool, das Websites einen Optimierungs‑Score basierend auf ihrer Kompatibilität mit KI‑Agenten zuweist, in vier Dimensionen: Auffindbarkeit, Inhalt, Zugangskontrolle und Fähigkeiten.

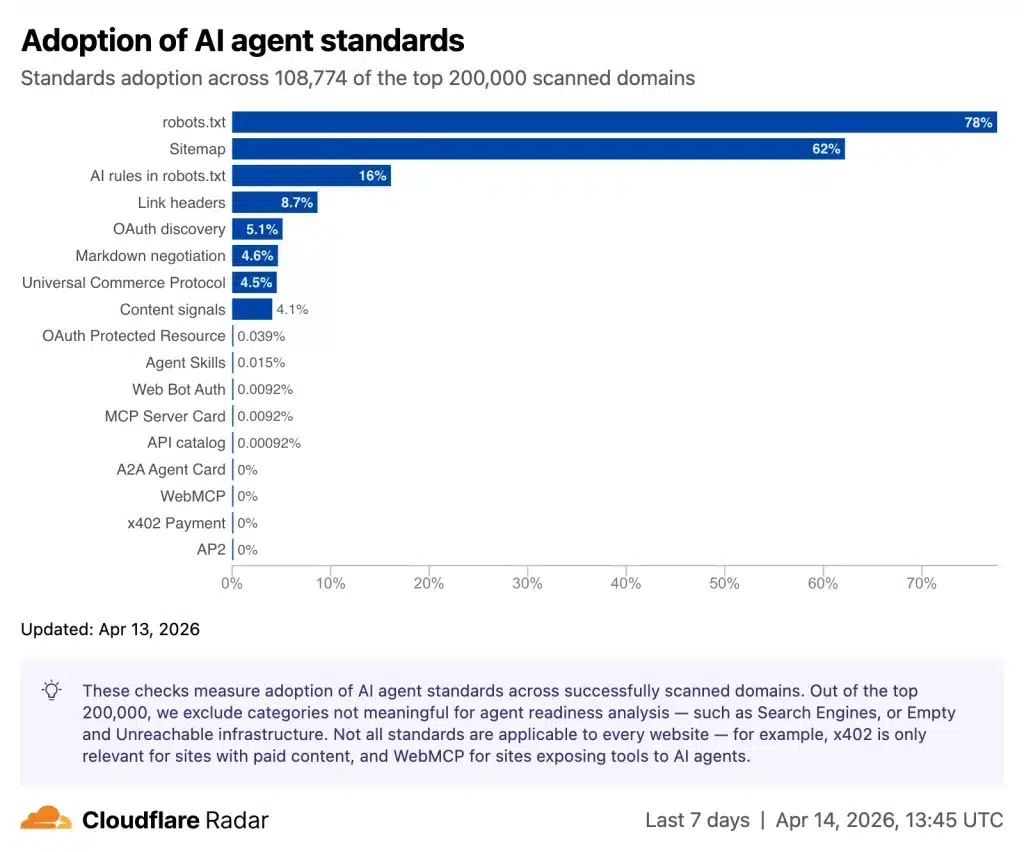

- Das Web ist noch lange nicht bereit: Nur 4 % der 200.000 analysierten Websites geben ihre Nutzungspräferenzen für KI an, und weniger als 15 Websites haben die neuesten Standards wie MCP Server Cards oder API Catalogs übernommen.

- Die Initiative stützt sich auf ein im Aufbau befindliches Standard-Ökosystem, was frühe Anwender dem Risiko von Fragmentierung oder schneller Veralterung aussetzt.

- Cloudflare ist sowohl Schiedsrichter des Scores als auch Anbieter von Lösungen zu dessen Verbesserung, eine Position, die hinterfragt werden sollte.

Ein Bewertungswerkzeug für ein reales Problem

Ausgangspunkt von Cloudflare ist solide. Wenn ein KI-Agent wie Claude, Cursor oder OpenCode versucht, auf eine Website zuzugreifen, um Dokumentation zu lesen, ein Produkt zu kaufen oder mit einer API zu interagieren, trifft er auf eine Infrastruktur, die für Menschen gedacht ist: dichtes HTML, Formulare, Browsersitzungen, Captchas. Das Ergebnis sind langsame Agenten, tokenintensiv und oft ungenau.

Um das Ausmaß des Problems zu messen, hat Cloudflare die gescannt Die 200.000 meistbesuchten Domains im Web, indem Redirects, Werbeserver und Tunneling-Dienste herausgefiltert wurden, um sich auf Websites zu konzentrieren, mit denen Agenten vernünftigerweise interagieren könnten.

Das Ergebnis ist aufschlussreich: 78 % der Seiten haben eine Datei robots.txt, aber nahezu alle wurden für traditionelle Suchmaschinen-Crawler geschrieben, nicht für Agenten. Nur 3,9 % der Websites liefern Inhalte in Markdown, wenn man sie darum bittet. Und aufkommende Standards wie die MCP-Serverkarten sind in weniger als 15 Websites im gesamten Datensatz vorhanden.

Von Cloudflare vorgestellt, bietet die Lösung isitagentready.com dann einen Score, der um vier Bereiche herum strukturiert ist.

- Die Auffindbarkeit (discoverability) prüft das Vorhandensein und die Qualität von

robots.txt, einessitemap.xmlund von Link-Headern. - Der Inhalt (content) prüft, ob die Website auf Anfrage eines Agenten eine saubere Markdown-Version ausliefern kann.

- Der Zugriffssteuerung für Bots (bot access control) prüft, ob die Website klare Präferenzen darüber angibt, was KI mit ihrem Inhalt tun darf.

- Schließlich, die Fähigkeiten prüfen sie das Vorhandensein fortgeschrittener Standards wie MCP Server Cards, API Catalog oder OAuth-Discovery, damit Agenten sich ordentlich authentifizieren können.

Noch rudimentäre Standards und nahezu keine Verbreitung

Hier muss die Begeisterung für Cloudflare jedoch gebremst werden. Viele der in diesem Score hervorgehobenen Standards befinden sich entweder noch in der Ausarbeitung bei der IETF oder sind informelle Vorschläge ohne Garantie auf allgemeine Übernahme. Das API Catalog (RFC 9727), die MCP-Serverkarten oder auch das Web Bot Auth sind jüngere Standards, von denen einige zum Zeitpunkt der Veröffentlichung noch nicht den endgültigen RFC-Status erreicht hatten.

Diese Situation ist nicht auf Cloudflare beschränkt: Das ist die Realität eines sich im Wandel befindlichen Webs. Aber sie verlangt eine Ehrlichkeit, die der Cloudflare-Blogeintrag dazu neigt, zu verharmlosen. Heute einen Standard zu übernehmen, der in achtzehn Monaten überarbeitet oder aufgegeben wird, bedeutet potenziell, sich auf Integrationsarbeit einzulassen, die wiederholt werden muss. Die großen Akteure, die die Ressourcen haben, diesen Entwicklungen zu folgen, werden davon profitieren. Kleine Teams oder unabhängige Entwickler weniger.

Der Fall von llms.txt ist exemplarisch. Im September 2024 vorgeschlagen, ist diese standardisierte Datei, um eine Website einem LLM vorzustellen, nicht standardmäßig im Cloudflare-Score enthalten, sondern nur optional. Der Grund? Der Standard ist noch umstritten. Das ist eine vorsichtige Entscheidung, die jedoch darauf hindeutet, dass selbst Cloudflare noch nicht genau weiß, auf welche Lösungen es setzen soll.

Inhaltsverhandlung in Markdown: ein echter, messbarer Gewinn

Einer der greifbarsten Aspekte der Initiative und wahrscheinlich der am unmittelbarsten nützliche betrifft die Fähigkeit eines Servers, in Markdown zu antworten, wenn ein Agent einen Header sendet Accept: text/markdown. Cloudflare gibt an, gemessen zu haben bis zu 80 % weniger benötigte Tokens um eine Seite zu lesen, verglichen mit ihrer HTML-Version.

Diese Zahl muss kontextualisiert werden. Das HTML einer technischen Dokumentationsseite ist oft sehr ausufernd: Navigation, Menüs, Skripte, verschachtelte Tags … all das ist reines Rauschen für ein LLM. Eine gut strukturierte Markdown-Datei, Das ist das Wesen des Inhalts ohne Verpackung. Die unmittelbare Folge ist eine Senkung der API-Kosten für die Agenten, eine Verringerung der Latenz und eine höhere Wahrscheinlichkeit, dass der Agent den vollständigen Kontext hat, ohne ihn zu kürzen.

Zur Veranschaulichung erklärt Cloudflare, dass es seine eigene Dokumentationsseite (developers.cloudflare.com) getestet hat, indem es einen Agenten (Kimi-k2.5 über OpenCode) auf mehrere technische Seiten zugreifen ließ. Ergebnis: 31 % weniger verbrauchte Tokens und um 66 % schnellere korrekte Antworten im Vergleich zu anderen nicht optimierten Seiten. Diese Zahlen sind mit Vorsicht zu genießen, da sie aus internen, nicht geprüften Tests stammen. Doch die Größenordnung stimmt mit dem überein, was man über die strukturelle Überladung von HTML weiß.

Technische Umsetzung in Cloudflare Docs: pragmatisch und reproduzierbar

Der lehrreichste Teil des Beitrags ist vielleicht der, der beschreibt Wie Cloudflare seine eigene Dokumentation überarbeitet hatDie Herangehensweise ist interessant, weil sie ein reales Problem umgeht: Im Februar 2026 senden nur drei der sieben getesteten Tools (Claude Code, OpenCode und Cursor) automatisch den Header Accept: text/markdownFür die anderen braucht es eine Alternative.

Die gewählte Lösung kombiniert zwei Cloudflare-Regeln:

- Eine URL-Umschreibung, die eine Anfrage an

/r2/get-started/index.mdin eine Anfrage an/r2/get-started/, - Und eine Header-Transformation, die automatisch hinzufügt

Accept: text/markdownzu diesen umgeschriebenen Anfragen.

Ergebnis : Jeder Agent kann auf die Markdown-Version jeder Seite zugreifen, indem er einfach /index.md an die URL anhängt, ohne einen speziellen Header verwalten zu müssen.

Eine weitere bemerkenswerte Entscheidung: Anstatt einer einzigen großen Datei llms.txt (die Cloudflare-Dokumentation umfasst mehr als 5.000 Seiten) verfügt jedes Verzeichnis der obersten Ebene über seine eigene Datei, und die Stammdatei verweist auf diese Unterverzeichnisse. Das verhindert die im Artikel beschriebene „Grep-Schleife“: Ein Agent, der mit einer Datei konfrontiert wird, die zu lang ist, um in sein Kontextfenster zu passen, beginnt, nach Schlüsselwörtern zu suchen, verliert den Überblick, erhöht die Anzahl der Anfragen und verschlechtert die Qualität seiner Antworten.

Die Granularität wurde ebenfalls sorgfältig ausgearbeitet. : etwa 450 Seiten, die nur Linklisten (Verzeichnisseiten) sind, wurden aus dem llms.txt, da sie für ein LLM, dessen Unterseiten bereits einzeln aufgelistet sind, keinen semantischen Mehrwert bieten.

Ein Akteur, der bewertet und die Vorbereitung auf die Bewertungen verkauft

Die Position von Cloudflare verdient eine genaue Prüfung. Das Unternehmen veröffentlicht den Referenzscore für die "agent readiness", integriert diesen Score in seinen URL-Scanner, bietet gebrauchsfertige Prompts zur Behebung jedes einzelnen Fehlers an… und verkauft die Produkte (Workers, Rules, Access), mit denen sich diese Korrekturen umsetzen lassen. Der isitagentready.com wird selbst von Cloudflare bedient und stellt einen MCP-Server bereit.

Das ist nicht unbedingt problematisch: Google hat dasselbe mit Lighthouse und den Core Web Vitals getan., und wird damit zugleich zum Richter der Leistung und zum Anbieter von Werkzeugen zu deren Verbesserung (über Google Cloud, Firebase etc.). Das bedeutet aber auch, dass sich die Kriterien des Scores ebenso nach den kommerziellen Interessen des Unternehmens wie nach den tatsächlichen Bedürfnissen der Agenten verändern können. Ein von einem einzelnen Unternehmen getragenes Standardwerk, selbst wenn es gute Absichten hat, bleibt ein Standard, dessen Ausrichtung beeinflussbar ist.

Es ist außerdem bemerkenswert, dass Cloudflare aktiv Standards im Zusammenhang mit agentischen Zahlungen vorantreibt (x402, Universal Commerce Protocol), an denen teils direkte Partner wie Coinbase beteiligt sind. Diese Standards sind noch nicht Teil des Scores, aber ihre Präsenz im Tool weist bereits auf eine Richtung hin.

Was Entwickler heute konkret tun können

Trotz dieser Vorbehalte haben mehrere Maßnahmen einen klaren und unmittelbaren Return on Investment, unabhängig von der Entwicklung der Standards:

- Markdown auf Anfrage auszuliefern ist technisch einfach, senkt die Kosten für API-Nutzer und verbessert die Qualität der Antworten der Agenten. Das hat Priorität.

- Sorgfalt bei

robots.txtfür KI-Agenten (indem man Anweisungen für Crawler wieGPTBot,ClaudeBot,CCBot, etc.) ist eine gute Praxis, die nichts kostet und die Zugriffsrechte klärt. - Einen strukturieren

llms.txtpro Abschnitt für Websites mit viel Inhalt ist eine gute Dokumentationspraxis, die sowohl Agenten als auch Menschen zugutekommt, die die Architektur einer Website schnell verstehen wollen.

Andererseits wäre es, MCP Server Cards oder API Catalogs zu implementieren für eine Website, die noch keine öffentliche API oder klar definierten agentischen Anwendungsfall hat, so als würde man einen Warteraum bauen, bevor Besucher vorhanden sind.

Adoption als Marktindikator, nicht als Verpflichtung

Der eigentliche Wert der Cloudflare-Initiative liegt vielleicht in dem Dataset Radar den sie einführt: eine wöchentliche Verfolgung der Übernahme jedes Standards durch die 200.000 meistbesuchten Websites, segmentiert nach Domainkategorien. Solche Daten werden zeigen, ob die Standards tatsächlich "gewinnen" oder ob die meisten Sites passiv bleiben und darauf warten, dass sich die Agenten an sie anpassen, wie sie sich bereits seit dreißig Jahren an HTML anpassen.

Die Antwort auf diese Frage wird viel über die Machtverhältnisse zwischen Website-Betreibern und Agenten-Entwicklern aussagen. Wenn die beliebtesten Agenten schließlich ausreichend robuste HTML-Parsing-Fähigkeiten integrieren, nimmt der Druck auf Seiten, sich anzupassen, ab. Wenn hingegen die Kosten und Verzögerungen beim Umgang mit nicht optimiertem HTML zu einem messbaren Wettbewerbsvorteil für die sich anpassenden Sites werden, wird die Adoption ganz natürlich folgen.

Der Artikel „Cloudflare bewertet Ihre Website im Zeitalter der KI‑Agenten mit dem Agent Readiness Score“ wurde auf der Website veröffentlicht. Fülle.