In un solo giorno, la startup parigina ha svelato tre annunci importanti che confermano l'ambizione di diventare un elemento imprescindibile dell'infrastruttura IA mondiale. Ecco cosa cambia concretamente.

Da ricordare:

- Mistral Small 4 unifica per la prima volta ragionamento, multimodalità e codice agentico in un unico modello, con licenza Apache 2.0.

- Mistral si unisce alla coalizione Nemotron di NVIDIA come membro fondatore, insieme a Perplexity, Cursor e Black Forest Labs.

- Leanstral è il primo agente open source capace di generare prove formali di codice per Lean 4, con un rapporto costo/prestazioni dichiarato fino a 15 volte superiore rispetto ai concorrenti generalisti.

- Questi tre annunci delineano un riposizionamento strategico: Mistral non si presenta più come un'alternativa nazionale, ma come un attore di riferimento a livello mondiale.

Small 4: un modello che sostituisce tre implementazioni

Finora, i team tecnici che volevano sfruttare i modelli Mistral dovevano scegliere tra diversi strumenti specializzati: Magistral per il ragionamento, Pixtral per l'elaborazione delle immagini, Devstral per il codice agentico. Mistral Small 4 pone fine a questa frammentazione.

Il modello si basa su un'architettura Mixture of Experts (MoE): 119 miliardi di parametri in totale, ma solo 6 miliardi attivi per richiesta. Questo funzionamento permette di mantenere un'ampia capacità complessiva limitando al contempo il costo computazionale per ogni inferenza. Rispetto a Mistral Small 3, la startup annuncia una riduzione della latenza del 40% e tre volte più richieste al secondo in una configurazione ottimizzata per la velocità di elaborazione.

La finestra di contesto raggiunge 256.000 token, il che consente di trattare documenti lunghi senza doverli suddividere. Il modello accetta in input sia testo sia immagini.

L'aggiunta più notevole per gli usi professionali è il parametro reasoning_effortCi permette di scegliere tra una risposta rapida e leggera, equivalente al comportamento di Small 3, e un'analisi approfondita, passo dopo passo, comparabile ai precedenti modelli Magistral. Un singolo deployment copre quindi esigenze che prima ne richiedevano tre.

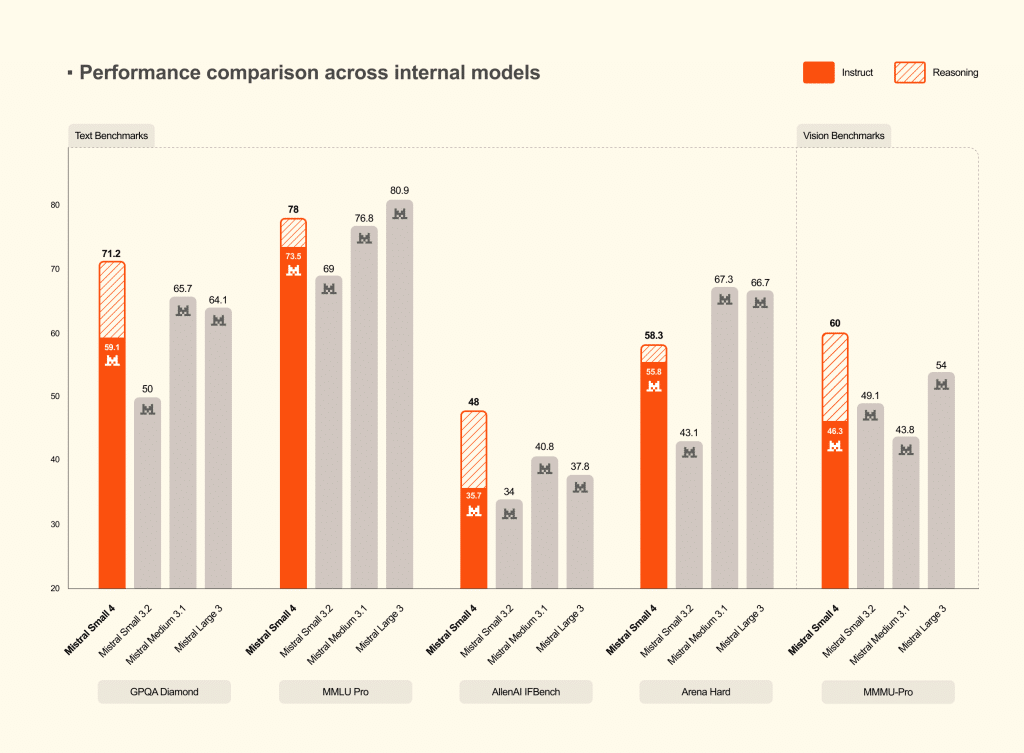

Nei benchmark, Mistral afferma che Small 4 con il ragionamento attivato eguaglia o supera GPT-OSS 120B nelle tre valutazioni testate, producendo al contempo uscite significativamente più brevi. Uscite più brevi significano meno latenza, costi di inferenza inferiori e una migliore esperienza utente in produzione.

Il modello è disponibile tramite l'API Mistral, Hugging Face e come container ottimizzato NVIDIA NIM per i deployment on-premise. È pubblicato con licenza Apache 2.0 ed è compatibile con i framework di inferenza più diffusi: vLLM, llama.cpp, SGLang e Transformers.

La coalizione Nemotron: Mistral si siede al tavolo dei grandi

È probabilmente l'annuncio più strategico della giornata. Mistral si unisce alla coalizione Nemotron di NVIDIA come membro fondatore, accanto a Cursor, Perplexity, Black Forest Labs e al laboratorio di Mira Murati.

L'obiettivo di questa coalizione è co-sviluppare un modello di base open sourceNemotron 4, addestrato sul cloud DGX di NVIDIA. Il modello sarà poi pubblicato in open source affinché l'intero settore possa specializzarlo. Ogni membro apporta competenze complementari: multilingue e architettura del modello per Mistral, ricerca per Perplexity, orchestrazione per LangChain, multimodalità per Black Forest Labs.

Per Mistral significa accedere all'infrastruttura di calcolo di NVIDIA per addestrare modelli a una scala che non potrebbe finanziare da sola. In cambio, la startup apporta le sue tecniche di addestramento, le sue capacità multimodali e i suoi strumenti di fine-tuning orientati alle aziende.

La logica industriale è chiara. Di fronte agli ecosistemi chiusi di OpenAI e Google, questa coalizione struttura il campo open source in una forza coordinataPer NVIDIA, un modello di riferimento ottimizzato per i suoi chip rafforza meccanicamente la domanda di hardware.

Questa alleanza non è senza tensioni. Il cloud DGX su cui Nemotron 4 sarà addestrato appartiene a NVIDIA. Mistral lo ha ben capito: l'azienda investe parallelamente nelle proprie capacità di calcolo, in Francia e in Sveziaperché questa partnership rimanga una scelta strategica e non una dipendenza forzata. Rimane aperta la questione della sovranità tecnologica: Mistral rafforza un legame con un attore americano soggetto alle normative extraterritoriali degli Stati Uniti.

Leanstral: quando l'IA dimostra di avere ragione

Il terzo annuncio è il più tecnico. Si rivolge oggi a un pubblico ristretto, ma riguarda un problema fondamentale dell'IA agentica.

Il problema che Leanstral cerca di risolvere

Quando un agente IA genera codice oggi, il risultato è probabilistico. Il codice sembra corretto, supera i test, ma non esiste alcuna garanzia assoluta. La verifica si basa sugli esseri umani, che rileggono, testano e correggono. Più gli agenti producono rapidamente, più questo collo di bottiglia umano diventa critico.

Esiste una soluzione a questo problema: la dimostrazione formale. Un assistente di dimostrazioni come Lean 4 permette a uno sviluppatore di scrivere non solo un programma, ma anche la sua dimostrazione matematica. Se la dimostrazione è valida, il codice è garantito corretto, non « probabilmente corretto », non « corretto nei casi testati », ma corretto nel senso matematico del termine. Lean 4 è già usato da matematici per formalizzare dimostrazioni complesse e da ingegneri per certificare software critico.

Il problema è che scrivere dimostrazioni in Lean 4 è un lavoro da specialisti, lento ed esigente. È proprio questo vuoto che Leanstral cerca di colmare.

Ciò che Leanstral fa concretamente

Leanstral è un agente IA da 6 miliardi di parametri attivi, addestrato specificamente per generare dimostrazioni formali in Lean 4. Non si limita a produrre codice: genera la dimostrazione che certifica quel codice. Lean 4 verifica poi quella dimostrazione. Se è invalida, viene respinta. Il verificatore è incorruttibile.

È il primo agente open source di questo tipo per Lean 4. I sistemi esistenti sono o sovrapposti a modelli generalisti, o limitati a problemi matematici isolati. Leanstral è progettato per funzionare in repository formali reali, con un'architettura sparse e un'ottimizzazione specifica per i compiti di dimostrazione.

I benchmark e i loro limiti

Su FLTEval, la loro suite di valutazione, Leanstral raggiunge un punteggio di 26,3 per 36 dollari (pass@2), contro 23,7 per 549 dollari per Claude Sonnet 4.6. A pass@16, Leanstral raggiunge 31,9, superando Sonnet di 8 punti. Claude Opus 4.6 rimane il migliore in assoluto con un punteggio di 39,6, ma a 1.650 dollari, cioè 92 volte più caro.

Questi numeri meritano una lettura prudente. FLTEval è un benchmark interno, non riprodotto da terzi. Il confronto dei costi che oppone un modello specializzato da 6 miliardi di parametri attivi a modelli generalisti massivi non è neutro: è uno strumento ottimizzato per un compito preciso rispetto a dei coltellini svizzeri. La capacità di Leanstral di generalizzare oltre il progetto matematico FLT su cui è stato valutato resta da dimostrare. Infine, tutti i test sono stati condotti nell'ambiente Mistral Vibe.

Perché è importante oltre la matematica

La vera posta in gioco è quella di la fiducia negli agenti autonomis. Oggi, un agente IA scrive codice e agisce sui dati senza che ogni riga venga verificata. Un agente in grado di dimostrare formalmente che il suo codice fa esattamente ciò che gli è stato richiesto cambia le regole del gioco: l'umano specifica il risultato atteso, la macchina dimostra di averlo prodotto. La supervisione si sposta dalla verifica riga per riga alla definizione delle specifiche.

Leanstral è disponibile immediatamente tramite Mistral Vibe (comando /leanstall), tramite un'API gratuita (labs-leanstral-2603) e con download diretto dei pesi sotto licenza Apache 2.0.

Un riposizionamento strategico deliberato

Letti insieme, questi tre annunci non sono lanci di prodotti isolati. Descrivono una traiettoria.

- Small 4 copre il mercato aziendale con un modello versatile, performante ed efficiente.

- La coalizione Nemotron dà a Mistral una presenza nella definizione degli standard mondiali dell'IA open source.

- Leanstral mostra la profondità di una R&S che va oltre i modelli di chat.

Mistral punta al miliardo di euro di fatturato quest'anno, sta costruendo un datacenter in Svezia, ha firmato con il ministero delle Forze Armate a gennaio e ha acquisito Koyeb a febbraio. Il tutto mantenendo una politica open source coerente con la licenza Apache 2.0. La questione ancora aperta è quella della sostenibilità: per quanto tempo un'azienda in iper-crescita può pubblicare i suoi modelli gratuitamente finanziando al contempo l'enorme infrastruttura necessaria per addestrarli?

L'articolo «Mistral colpisce duro: nuovo modello, alleanza con NVIDIA e agente di prova formale» è stato pubblicato sul sito Abondance.