A Arcep, o regulador francês das telecomunicações, publicou em janeiro de 2026 um relatório de 104 páginas dedicado ao impacto da IA generativa na internet aberta. Apoiado numa investigação empírica realizada sobre três serviços de IA (Mistral, Gemini, Perplexity), este documento fornece dados concretos sobre questões que preocupam diretamente os profissionais de SEO e os editores de sites: queda de tráfego, opacidade das fontes citadas pelas IA, aumento dos crawlers e emergência do GEO.

O que é preciso reter:

- O tráfego proveniente dos motores de busca continuará a diminuir com a generalização dos resumos por IA.

- Estar bem posicionado no Google já não basta para aparecer nas respostas das IA.

- As regras do GEO ainda são vagas e próprias de cada serviço de IA — o que complica qualquer estratégia.

- O domínio dos crawlers e do robots.txt torna-se uma questão técnica urgente para os editores.

- A IA agentiva vai criar uma nova camada de intermediação, potencialmente ainda mais opaca do que as anteriores.

Do SEO ao GEO: uma mudança em curso

A constatação central do relatório é inequívoca: as IA generativas estão a tornar-se novas “portas de entrada” para a internet, da mesma forma que os motores de busca ou as redes sociais. O utilizador já não navega de link em link; faz uma pergunta e recebe uma resposta sintética, formulada em linguagem natural. Essa mudança de um “motor de busca” para um “motor de resposta” redefine profundamente as regras do jogo para os editores.

Para os profissionais do referenciamento, isso traduz-se por uma evolução importante das práticas: as estratégias SEO tradicionais, baseadas na estrutura do site, nos sinais de autoridade de domínio e na frescura do conteúdo, já não são suficientes. O desafio agora deixou de ser aparecer numa boa posição numa lista de resultados, mas deser identificado como fonte pertinente por um agente generativo e efetivamente citado na sua respostaEsta nova disciplina é comumente designada pelo termo GEO (Otimização de Motor Generativo).

O estudo IMPACTIA do PEReN, realizado sobre 200 000 citações analisadas, traz uma perspetiva valiosa: as fontes citadas pelas IA generativas coincidem apenas parcialmente com os primeiros resultados do Google. A taxa de interseção com o top 5 do Google não excede 19 a 32% dependendo das ferramentas testadas. Em outras palavras, estar bem posicionado no Google já não garante ser citado por uma IA, e vice-versa.

Tráfego em queda livre: números alarmantes

O relatório da Arcep de janeiro de 2026 confirma o que muitos editores já sentem nas suas análises: a generalização dos resumos por IA reduz o tráfego de entradaO exemplo mais marcante vem de um estudo do Pew Research Center, citado pela Arcep: os utilizadores expostos a um resumo através dos Google AI Overviews clicam numa fonte externa apenas em 8% dos casos.

Mesmo Wikipédia, no entanto, o domínio mais citado por todas as IAs estudadas (até 19% das citações na categoria “história”) relata uma queda de tráfego notável desde a chegada das ferramentas de IA generativa. Se até os sites mais referenciados por essas ferramentas veem sua audiência diminuir, a situação dos editores de porte mais modesto é logicamente ainda mais preocupante.

Essa tendência levanta também uma questão económica: a visibilidade condicionando em grande parte as receitas publicitárias e as assinaturas, uma queda duradoura do tráfego ameaça diretamente a viabilidade financeira dos editores independentes. Sites de informação relatam de fortes quedas de audiência desde que as grandes plataformas integraram funcionalidades de IA generativa nas suas interfaces de pesquisa.

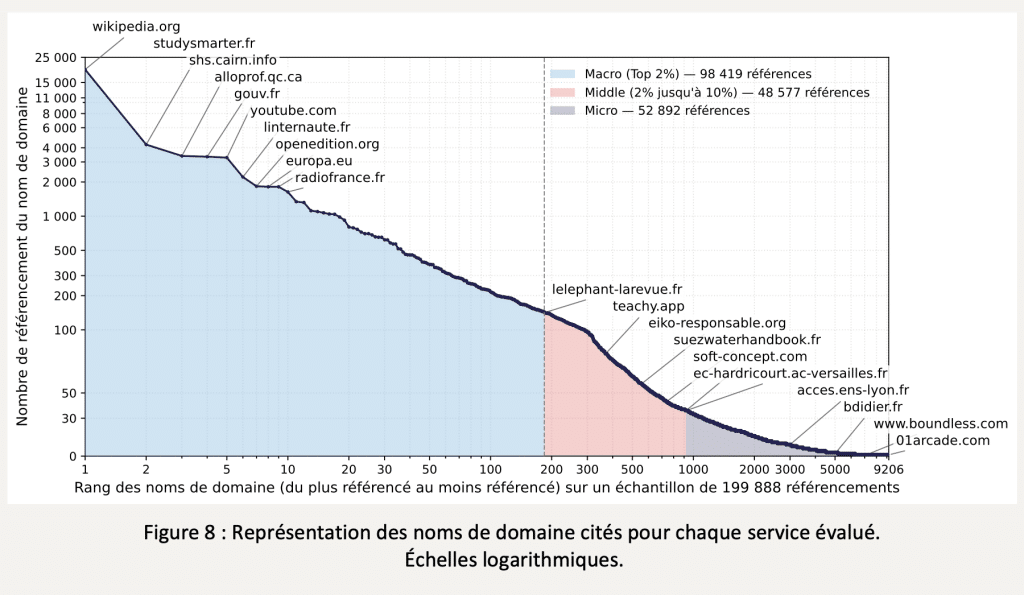

Concentração das fontes: 2% dos domínios captam 49% das citações

Um dos resultados mais marcantes do estudo IMPACTIA diz respeito à concentração extrema das fontes mobilizadas pelas IA. De 9 206 nomes de domínio citados, os 2% mais referenciados, ou seja 185 domínios, representam por si só quase 49% das 200 000 citações analisadas. No outro extremo, 72% dos domínios são citados apenas entre 1 e 10 vezes no total.

A Wikipédia impõe-se como a fonte dominante em todas as categorias testadas. Seguem-se, de forma surpreendente, sites de apoio aos trabalhos escolares como studysmarter.fr ou alloprof.ca. Os critérios que explicam essas escolhas permanecem amplamente opacos : os algoritmos de seleção e ponderação das fontes pelas IA não são nem documentados, nem padronizados, nem acessíveis aos editores.

Outro ensinamento importante: cada serviço de IA tem seus próprios vieses de citação. Alguns domínios muito citados por um estão quase ausentes entre os seus concorrentes. Essa variabilidade torna ainda mais difícil a construção de uma estratégia de visibilidade coerente para os editores, que não podem apoiar-se em regras estáveis e universais como acontece com o SEO clássico.

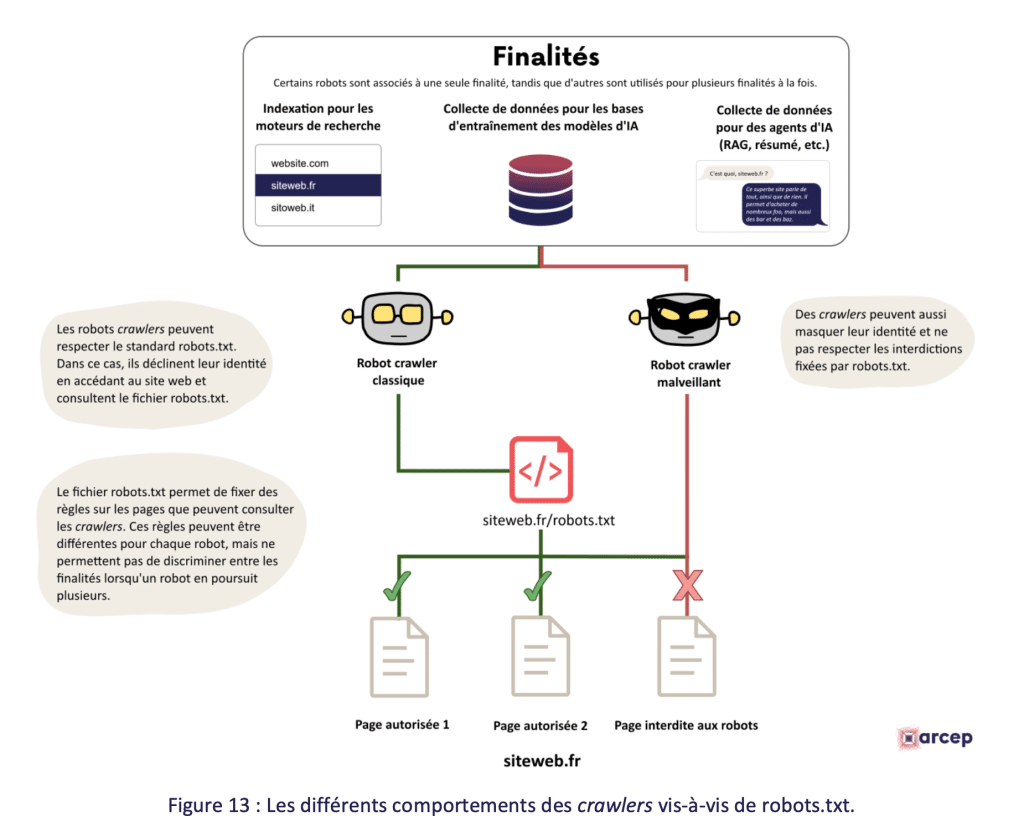

Crawlers e robots.txt: uma relação que se tornou conflituosa

Do ponto de vista técnico, o relatório aponta uma tensão crescente em torno dos robôs de indexação (crawlers) usados pelos atores da IA para coletar dados na web. Desde 2022, vários editores de sites registam um aumento significativo do seu tráfego relacionado com bots. A Cloudflare estima que o tráfego dos crawlers poderá superar o tráfego humano já em 2029.

O protocolo robots.txt, concebido originalmente para permitir que os editores controlem a indexação das suas páginas, encontra-se fragilizado. Alguns crawlers de IA não respeitam as suas directivas, chegando mesmo a saturar os servidores a ponto de provocar indisponibilidades. A fundação Wikimedia indica que 65% do seu tráfego provém agora de robôs.

O problema central é a ausência de um mecanismo que permita distinguir tecnicamente os crawlers de IA dos crawlers dos motores de busca: bloquear uns significa arriscar bloquear os outros, e assim penalizar o seu próprio SEO. Face a este vazio, surgem as primeiras soluções:

- O modelo pay-per-crawl da Cloudflare (usando o código HTTP 402 "Payment Required"), que permite aos editores monetizar o acesso dos seus conteúdos aos robôs de IA.

- O projeto ai.txt (Artificial Intelligence Access Protocol), uma evolução do robots.txt que permite especificar, de forma granular, as condições de uso dos dados conforme a sua utilização: treino, indexação ou funcionalidades agentivas.

- Dos trabalhos de normalização no W3C e na IETF para adaptar os protocolos existentes às especificidades da IA generativa.

A IA agentiva: o próximo desafio para a visibilidade dos serviços

O relatório insiste também naemergência da IA agentiva, sistemas capazes não só de gerar texto, mas também de agir directamente em nome do utilizador: reservar um bilhete, efectuar uma compra, aceder a um serviço terceiro. Nesse esquema, é o agente que escolhe os prestadores, as aplicações e os serviços a mobilizar, e não o utilizador.

Já foram celebrados acordos comerciais: a OpenAI com a Walmart, Etsy e Shopify; o Claude (Anthropic) com a Notion, Canva e Stripe; o Copilot com a OpenTable, Kayak e Instacart. Os serviços não parceiros correm simplesmente o risco de não ser oferecidos aos utilizadores, sem que estes o percebam. Esta lógica de "referenciamento fechado" constitui um risco estrutural para qualquer actor digital que não disponha dos meios para negociar tais acordos.

O artigo «O seu site ainda existe para a IA? Esclarecimento do último relatório da Arcep» foi publicado no site Abondance.