Quando a OpenAI mudou o modelo padrão em 4 de março, o número de sites citados por resposta caiu um quinto e nunca se recuperou. Mas essa queda é apenas parte da história. Também realizámos engenharia reversa das ferramentas internas de navegação do ChatGPT, conduzimos uma experiência do tipo honeypot, reconstruímos seu system prompt e lançámos uma nova versão do nosso plugin ChatGPT Search Capture.

O que aconteceu

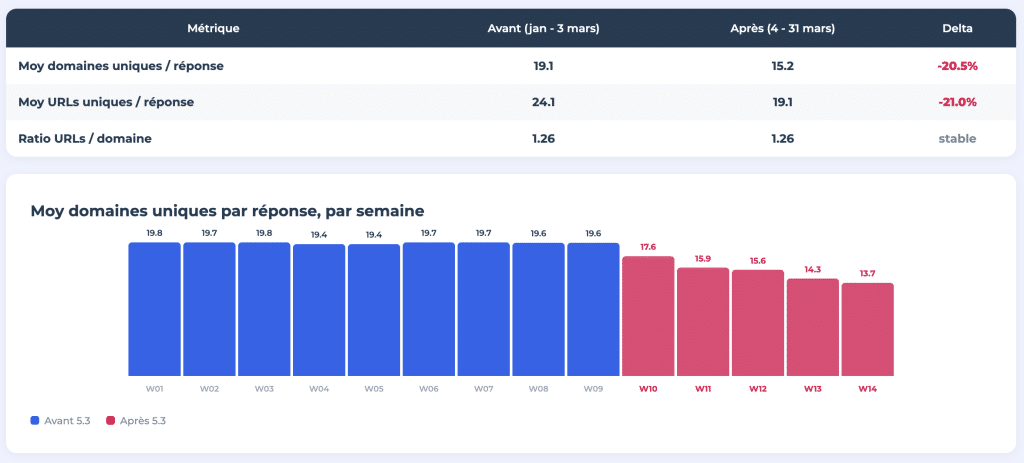

A 4 de março de 2026, o ChatGPT mudou seu modelo padrão de GPT-4o/5.2 para GPT-5.3 Instant. Resultado: o número médio de domínios únicos citados por resposta passou de 19,1 para 15,2, uma queda de mais de 20%. O número de URLs únicas por resposta seguiu a mesma trajetória, de 24,1 para 19,1.

Acompanhámos 400 prompts diários durante 14 semanas, apoiando-nos nos dados de monitorização fornecidos pela Meteoria. Todos os resultados são publicados sob a forma de um estudo interativo em oito partes em pensar.resoneo.com/chatgpt/5.3-5.4/.

Por que isso é importante

O ChatGPT tem 900 milhões de utilizadores ativos por semana. A superfície de citação em cada resposta não mudou, mas menos sites partilham essa superfície. O mesmo bolo, mas com menos fatias. Isso provavelmente reflete um deslize estrutural para fontes de maior autoridade, mas também significa, no geral, menos vencedores. Os sites que não passam na seleção perdem uma visibilidade que antes lhes estava acessível.

O efeito Bigfoot

Nomeámos este fenómeno em referência à "atualização Bigfoot" identificada pelo Dr. Pete (do Moz) em 2013, quando o Google por vezes deixava um único domínio ocupar a totalidade da primeira página…

O ChatGPT agora recupera menos domínios por resposta, mas a proporção URLs-por-domínio manteve-se estável em 1,26. A profundidade de rastreio por domínio não mudou. O que mudou foi o número de sites distintos que conseguem um lugar à mesa.

O GPT-5.4 Thinking acentua ainda mais essa concentração. O modelo utiliza operadores site: para restringir as pesquisas a domínios de confiança e distribui as suas consultas por frequentemente mais de 10 "fan-out queries" por resposta, cada uma direcionada a uma fonte específica.

A análise independente dos logs por Jérôme Salomon (Oncrawl) confirma essa tendência. O volume de rastreio do bot ChatGPT-User estabilizou-se num nível inferior desde a transição para o 5.3. Algumas páginas simplesmente deixaram de ser rastreadas. A causa vai além das atualizações de modelo: mais de 90% dos utilizadores semanais do ChatGPT estão num plano gratuito, e a experiência padrão desencadeia menos pesquisas na web, usa menos pedidos e produz menos citações.

Como o ChatGPT Search funciona realmente

O nosso estudo apresenta também uma engenharia reversa completa do sistema de pesquisa interno do ChatGPT, baptizado web.run. Antes do 5.3, o modelo enviava comandos textuais compactos, separados por pipes (fast|query|recency). Depois do 5.3, envia objetos JSON estruturados com parâmetros tipados. Isto não é uma mera mudança de formato. Reflete uma arquitetura diferente na forma como o modelo formula e distribui as suas operações web.

A ferramenta web suporta agora 12 operações, contra 4 anteriormente (além de um sistema de widgets separado, “genui”). Entre elas encontram-se: search_query, open, find, click, screenshot, product_querye widgets especializados para desporto, finanças, meteorologia, etc. O GPT-5.4 pode encadear de 5 a mais de 10 rondas de pesquisa por resposta, refinando os seus pedidos com base nos resultados anteriores. O GPT-5.3 Instant geralmente limita-se a 2 ou 3.

Vestígios do Google permanecem visíveis: marcadores de rastreamento do Google (strlid) aparecem nas URLs dos produtos, e as correspondências ID-para-token da SearchAPI revelam a dependência do backend em fornecedores de pesquisa terceiros, e no Google em segundo plano.

Um novo tipo de fan-out para consultas de produtos

Descobrimos um tipo de fan-out ainda não documentado: navegar_consultas_reescritasAparece exclusivamente nas consultas de produtos, no 5.4 Instant, e é visível no código da conversa.

Quando um utilizador faz uma pergunta do tipo « melhor impressora 3D para comprar em 2026 », o ChatGPT começa por lançar um único fan-out de reescrita para construir a lista completa de produtos candidatos. Depois lança um fan-out de compras separado para cada produto individual, recolhendo características, avaliações e preços um a um. Antes do 5.3, as pesquisas de produtos eram agrupadas numa única chamada. Cada produto passa agora a ter a sua própria operação dedicada de recuperação.

ChatGPT-User é o agente de recuperação

A nossa experiência honeypot confirmou um detalhe importante. Quando o ChatGPT navega na web após uma pesquisa durante uma conversa, é o crawler ChatGPT-User, e não o OAI-SearchBot, que vai buscar o conteúdo das páginas. A OpenAI descreve o OAI-SearchBot como o agente que constrói o índice de pesquisa do ChatGPT, mas na prática o modelo apoia-se em APIs de scraping de terceiros para obter os resultados de pesquisa, e depois envia o ChatGPT-User para recolher o conteúdo real das URLs selecionadas.

O ponto cego dos namespaces: a falha do ChatGPT

Esta é talvez a nossa descoberta mais surpreendente.

A pista começou com engenharia reversa clássica. Decompilámos a aplicação móvel ChatGPT, dissecámos o código‑fonte do cliente web e sniffámos os pacotes de rede nas duas plataformas. Isso deu‑nos os nomes das ferramentas internas e algumas convenções de chamada. Armados com esses elementos precisos, pudemos fazer as perguntas certas ao ChatGPT — e descobrimos que o modelo respondia sem quaisquer restrições.

A OpenAI implementou verdadeiras proteções em torno dos seus system prompts. Mas a camada de configuração das ferramentas internas não tem nenhuma. As espaços de nomes do ChatGPT, esses grupos de ferramentas internas que o modelo pode invocar durante uma conversa, são livremente descrevíveis. Desde que evite as palavras « system prompt », o modelo divulgará os esquemas das ferramentas, as listas de operações, os canais de saída e as estruturas de namespaces com perfeita coerência.

Publicámos prompts prontos a usar que qualquer pessoa pode colar no ChatGPT para auditar o seu ambiente interno. Para verificar se o modelo inventava essas descrições, realizámos um estudo participativo com dezenas de utilizadores, em sessões distintas. Cada participante recebeu exatamente os mesmos nomes de ferramentas, os mesmos esquemas de parâmetros, as mesmas listas de operações. O modelo descreve o seu próprio conjunto de ferramentas de forma consistente, portanto fiável ^^

O estudo inclui também um system prompt reconstruído por extração progressiva, acompanhado de várias informações notáveis: o Reddit é o único domínio isento dos limites de palavras relacionados com direitos de autor, existe uma lista granular de produtos proibidos, um «score de verbosidade excessiva» funciona numa escala de 1 a 10, e um parágrafo completo de política publicitária regula a exibição de anúncios por nível de subscrição.

Uso prático: realizar sua própria auditoria de crawlabilidade

A sintaxe web.run que documentámos não é apenas uma curiosidade técnica. Funciona, e abre um caminho direto para testar a forma como o ChatGPT interage com os seus conteúdos.

Aqui está um exemplo concreto. Pode forçar o ChatGPT a pesquisar o seu domínio e a ler páginas específicas colando comandos JSON diretamente numa conversa.

Primeiro, desencadeie uma pesquisa direcionada no seu site, depois obrigue-o a recuperar os dois primeiros resultados obtidos; peça-lhe em seguida que devolva o título, o tema principal e os pontos-chave de cada página.

Search for this query, then open the first two results and summarize what you find on each page.

Step 1 : Search:

{

"search_query": [

{ "q": "site:abondance.com seo" }

],

"response_length": "short"

}

Step 2 : Open the first two results:

{

"open": [

{ "ref_id": "turn0search0" },

{ "ref_id": "turn0search1" }

]

}

Step 3 : Give me a structured recap of what you found on each URL. For each page: the title, the main topic, and 3-5 key points.O que obtém é uma visão do seu conteúdo através dos olhos do ChatGPT: o que ele consegue realmente alcançar, o que dele extrai e como interpreta as suas páginas. Se não conseguir aceder a uma página, devolver conteúdo confuso ou falhar totalmente em captar as suas mensagens principais, é um sinal que exige ação.

Para ir mais longe, a extensão Chrome «ChatGPT Search Capture» da RESONEO (V3.3, gratuita no Chrome Web Store) permite visualizar as URLs exactas recuperadas durante qualquer conversa com o ChatGPT, incluindo as fan-out queries (excepto para o 5.3 Instant, agora operado no servidor), os ref_ids e os metadados do modelo. Combinada com os comandos JSON manuais acima, dispõe de uma auditoria de extraibilidade leve mas accionável: quais são as URLs que ele retorna e o que realmente extrai delas?

Mesma família de modelos, citações diferentes

GPT-5.2, 5.3 e 5.4 partilham a mesma data de cutoff (agosto de 2025) e pertencem à mesma família GPT-5. Contudo, o mesmo prompt enviado a cada um produz fan-out queries diferentes, recupera fontes distintas e destaca trechos diferentes na resposta final.

Várias camadas de divergência actuam após o pré-treinamento: o reward shaping do RLHF, os dados de fine-tuning supervisionado, as configurações do system prompt e os orçamentos de compute na inferência. O GPT-5.4 Pro recebe explicitamente mais compute para “refletir mais intensamente”, e isso por si só pode alterar quais as fontes citadas.

É por isso que recomendamos testar modelo a modelo. Um único prompt pode produzir citações radicalmente diferentes dependendo de o utilizador estar no GPT-5.3 Instant, no 5.4 Thinking ou no 5.4 Extended. Os utilizadores do plano gratuito também podem ser silenciosamente redireccionados para um modelo mais leve.

Dois tipos de visibilidade de IA

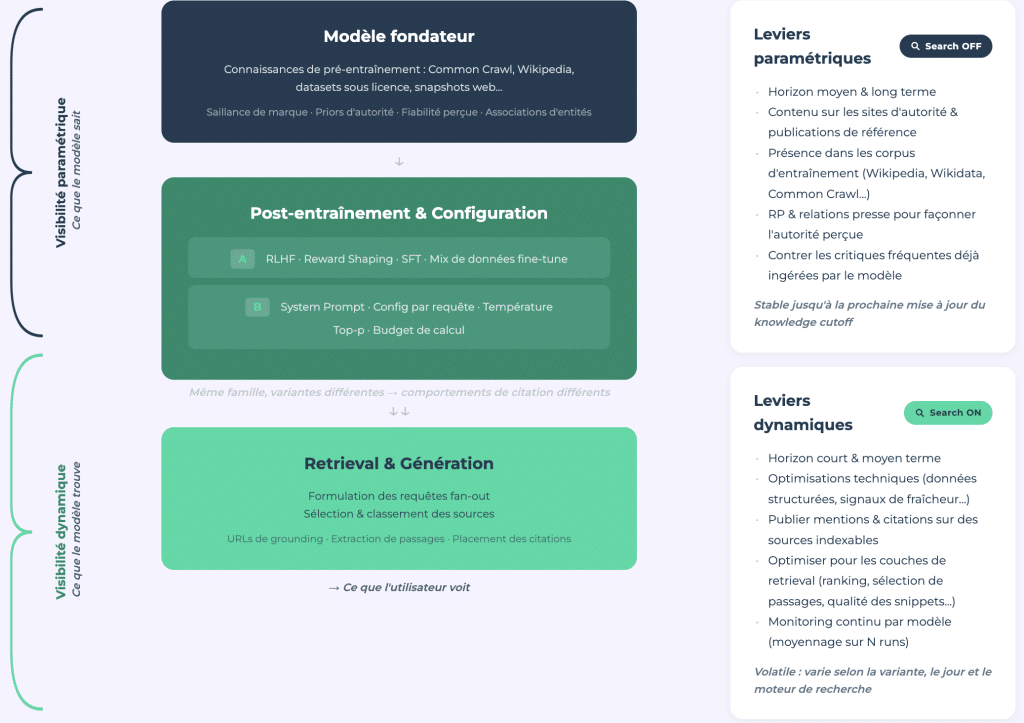

O nosso estudo apresenta um framework de análise que separa a visibilidade paramétrica (o que o modelo sabe graças aos seus dados de treino, pesquisa desactivada) da visibilidade dinâmica (o que recupera em tempo real, pesquisa activada).

Visibilidade paramétrica: o E-E-A-T dos LLMs

A visibilidade paramétrica é o equivalente E‑E‑A‑T para os grandes modelos de linguagem. É a autoridade codificada através de milhares de milhões de exemplos de treino, moldada pela cobertura mediática, pela presença na Wikipédia, por outros grandes sítios de autoridade e pelo corpus de treino no seu conjunto. É estável e mensurável via auditorias one‑shot por API.

Visibilidade dinâmica: um terreno em movimento

A visibilidade dinâmica, por sua vez, é volátil. Depende do modelo e exige monitorização contínua. Aproxima‑se mais do SEO tradicional e pode desabar de um dia para o outro com uma atualização do modelo, como demonstra o efeito Bigfoot.

A ligação entre os dois

A ligação entre as duas é importante. O modelo formula os seus pedidos web apontando para as fontes que já conhece. Uma marca ausente da memória paramétrica nem será considerada candidata à pesquisa. Ser desconhecido pelo modelo significa ser invisível antes mesmo de a pesquisa começar.

As atualizações da data de cutoff constituem a "Google Dance" dos LLMs. Quando a data de cutoff muda, os rankings paramétricos são redistribuídos em bloco. Mas isso acontece apenas cerca de uma vez por ano, porque o retreino nessa escala é extremamente dispendioso. A janela estratégica para influenciar o que o modelo sabe sobre a sua marca situa‑se entre duas datas de corte.

O AI Brand Authority Index de Dan Petrovic (DEJAN) ilustra a medição paramétrica em grande escala. O nosso estudo complementa‑o com um quadro de teste mais leve e reprodutível, baseado em cinco prompts executados várias vezes para uma auditoria one‑shot.

Para ir mais longe

O estudo completo (documentação reverse‑engineered, experiência honeypot, prompts de auditoria DIY e system prompt reconstruído) está disponível em pensar.resoneo.com/chatgpt/5.3-5.4/.

Em síntese

O ChatGPT Search deixou de ser uma caixa preta. Este estudo mapeia a sua arquitectura interna, desde a ferramenta web.run que impulsiona cada pesquisa até à lógica de fan‑out que decide quais os domínios a recuperar e quais os a ignorar.

A queda de 20% dos domínios citados após a passagem para 5.3 mostra a que velocidade o panorama de citações pode virar com uma única atualização de modelo. Mas o problema de fundo é estrutural: o ChatGPT concentra as suas citações em menos sítios web e aplica uma lógica de seleção de fontes moldada pelos dados de treino, pelo fine‑tuning pós‑treino e por regras de system prompt que variam de modelo para modelo.

Seguir a visibilidade no ChatGPT implica compreender duas camadas distintas (paramétrica e dinâmica), testar em vários modelos e monitorizar um sistema cujas ferramentas internas são documentáveis mas cujo comportamento pode mudar de um dia para o outro.

Aestudo completo fornece os dados, a metodologia e as ferramentas para começar.

O artigo “Nos bastidores do ChatGPT Search: engenharia inversa do web.run, fan‑outs e as novas regras de visibilidade” foi publicado no site Abondance.